簡介

ELK並不是一款軟件,是一整套解決方案,是由ElasticSearch,Logstash和Kibana三個開源工具組成:通常是配合使用,而且先後歸於Elastic.co公司名下,簡稱ELK協議棧.

日誌的收集和處理

在日常運維工作中,對於系統和業務日誌的處理尤為重要。日誌主要包括系統日誌,應用日誌,應用程序日誌和安全日誌。系統運維和開發人員可以通過日誌了解服務器軟硬件信息,檢查配置過程中的錯誤及錯誤發生的原因。經常分析日誌可以了解服務器的負荷,性能安全性,從而及時採取措施糾正錯誤。

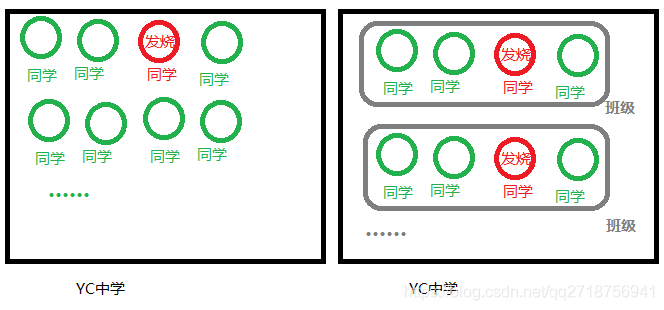

通常,日誌被分散的存儲在不同的設備上,如果你管理上百台服務器,你還在使用依次登錄每台機器的傳統方法查閱日誌是很繁瑣且效率低下的。當務之急是使用集中化的日誌管理,例如: 開源的syslog,將所有服務器上的日誌收集匯總。集中化管理日誌后,日誌的統計和檢索又成為一件比較麻煩的事情.

一個完整的集中式日誌系統,是離不開以下幾個主要特點的

# 1. 收集 - 能夠收集多種來源的日誌數據

# 2. 傳輸 - 能夠穩定的把日誌數據傳輸到中央系統

# 3. 存儲 - 如何存儲日誌數據

# 4. 分析 - 可以支持UI分析

# 5. 警告 - 能夠提供錯誤報告

日誌分析工具

1 . grep,awk,wc,rsyslog,syslog-ng: 對於龐大的機器數量,要達到要求更高的查詢,排序和統計等使用這樣的方法難免有點力不從心.

2 . 商業化的splunk: Splunk作為企業級的分佈式機器數據的平台,擁有強大的分佈式配置,包括跨數據中心的集群配置,Splunk提供兩種集群,indexer集群和Search Head集群.具體情況請看Splunk文章.

3 . 開源的:

# 1 FaceBook公司的Scribe

# 2 Apache的Chukwa

# 3 Linkedin的Kafka

# 4 Cloudera的Fluentd

# 5 ELK

Elasticsearch

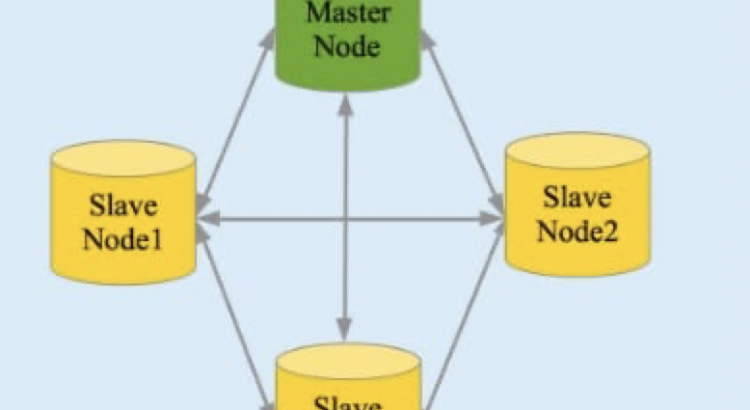

ElasticSearch是一個基於Lucene的開源分佈式搜索服務器.是一個實時的分佈式搜索和分析引擎,他可以用於全文搜索,結構化搜索以及分析,他是一個建立在全文搜索引擎Apache lucene基礎上的搜索引擎,使用Java語言編寫,並作為Apache許可條款下的開放源碼發布,是第二流行的企業搜索引擎。設計用於雲計算中,能夠達到實時搜索,穩定,可靠,快速,安裝使用方便,在elasticsearch中,所有節點的數據是均等的.

主要特點

# 1 實時分析

# 2 分佈式實時文件存儲,並將每一個字段都編入索引

# 3 文檔導向,所有的對象全部是文檔

# 4 高可用性,易擴展,支持集群(cluster),分片和複製(hards和Replicas

# 5 接口友好,支持JSON

Logstash

logstash是一個具有實時渠道能力的數據收集引擎,使用JRuby語言編寫,其做着是世界著名的運維工程師喬丹西塞,他是一個完全開源工具,可以對你的日誌進行收集,過濾

# 主要特點:

# 1> 幾乎可以訪問任何數據

# 2> 可以和多種外部應用結合

# 3> 支持彈性擴展

# 它主要由三個主要部分組成,見下圖.

# 1> Shipper - 發送日誌數據

# 2> Broker - 收集數據,缺省內置Redis

# 3> Indexer - 數據寫入

Kibana

Kibana是一款基於Apache開源協議,使用JavaScript語言編寫,為Elasticsearch提供分析和可視化的Web平台,他可以在Elasticsearch的索引中查找,交互數據,並生成各種維度的表圖.

Filebeat

ELK協議棧的新成員,一個輕量級開源日誌數據搜集器,基於Logstash-Forwarder源代碼開發,是對他的替代。是需要在採集日誌數據server上安裝filebeat,並指定日誌目錄或日誌文件后,Filebeat就能讀取數據,迅速發送到Logstash進行解析,亦或直接發送到Elasticsearch進行集中式存儲和分析

ELK協議棧體繫結構

最簡單架構

在這種架構中,只有一個Logstash,Elasticsearch和Kibana實例。Logstash通過輸入插件從多種數據源(比如日誌文件,標準輸入Stdin等)獲取數據,再經過過濾插件加工數據,然後經過Elasticsearch輸出插件輸出到Elasticsearch,通過Kibana展示.

Logstash作為日誌收集器

這種架構是對上面架構的擴展,把一個Logstash數據搜集節點擴展到多個,分佈於多台機器,將解析好的數據發送到Elasticsearch server進行存儲,最後在Kibana查閱,生成日誌報表等.

這種結構因為需要在各個服務器上部署Logstash,而它比較消耗CPU和內存資源,所以比較適合資源豐富的服務器,否則容易造成服務器性能下降,甚至可能導致無法正常工作.

Beats作為日誌搜集器

這種架構引入Beats作為日誌搜集器。目前Beats包括四種

# 1> Packetbeat (搜集網絡流量數據)

# 2> Topbeat (搜集系統,進程和文件系統級別的CPU和內存使用情況等數據)

# 3> Filebeat (搜集文件數據)

# 4> Winlogbeat (搜集Windows事件日誌數據)

Beats將搜集到的數據發送到Logstash,經Logstash解析,過濾后,將其發送到Elasticsearch存儲,並由Kibana呈現給用戶.

這種架構解決了Logstash在各服務器節點上佔用系統資源高的問題,相比Logstash,Beats所佔系統的CPU和內存幾乎可以省略不計,另外,Beats和Logstash之間保持SSL/TLS加密傳輸,客戶端和服務器雙向認證,保證了通信安全

因此這種架構適合對數據安全性要求較高,同時各服務器性能比較敏感的場景.

基於Filebeat架構的配置部署詳解

前面提到Filebeat已經完全替代了Logstash-Forwarder 成為新一代的日誌採集器,同時鑒於它輕量、安全等特點,越來越多人開始使用它。這個章節將詳細講解如何部署基於 Filebeat 的 ELK 集中式日誌解決方案,具體架構見下圖.

引入消息隊列機制的架構

Beats 還不支持輸出到消息隊列,所以在消息隊列前後兩端只能是 Logstash 實例。這種架構使用 Logstash 從各個數據源搜集數據,然後經消息隊列輸出插件輸出到消息隊列中。目前 Logstash 支持 Kafka、Redis、RabbitMQ 等常見消息隊列。然後 Logstash 通過消息隊列輸入插件從隊列中獲取數據,分析過濾后經輸出插件發送到 Elasticsearch,最後通過 Kibana 展示。見下圖

這種架構適合於日誌規模比較龐大的情況,但由於Logstash日誌解析節點和Elasticsearch的符合比較重,可將他們配置為集群模式,以分擔負荷,引入消息隊列,均衡了網絡傳輸,從而降低了網絡閉塞,尤其丟失數據的可能性,但依然存在Logstash佔用系統資源過多的問題.

部署

架構圖

999

List

Package:

# elasticsearch-7.2.0-linux-x86_64.tar.gz

# filebeat-7.2.0-x86_64.rpm

# jdk-8u121-linux-x64.rpm

# kibana-7.2.0-linux-x86_64.tar.gz

# logstash-7.2.0.tar.gz

| IP |

hostname |

軟件 |

配置要求 |

網絡 |

備註 |

| 192.168.144.131 |

ES/數據存儲 |

elasticsearch-7.2 |

內存最低2GB/硬盤40GB |

Nat,內網 |

|

| 192.168.144.128 |

Kibana/UI展示 |

kibana-7.2****logstash-7.2 |

內存最低2GB/硬盤40GB |

Nat,內網 |

|

| 192.168.144.135 |

Filebeat/數據採集 |

Filebeat-7.2/nginx |

內存最低2GB/硬盤40GB |

Nat,內網 |

|

注意事項

# 1.一定要對時,時間校正,不然日誌出不來

# 2.啟動Elasticsearch必須切換成所創建的ELK用戶啟動,不然ES處於安全目的,會啟動報錯.

# 3.日誌從Filebeat到Logstash再到ES檢索到Kibana的讀取速度取決於機器配置

Elasticsearch安裝

# 1.初始化

setenforce 0

sed -i '/^SELINUX=/ s/enforcing/disabled/' /etc/selinux/config

systemctl stop firewalld

systemctl disable firewalld

sed -i '/^GSSAPIAu/ s/yes/no/' /etc/ssh/sshd_config

sed -i '/^#UseDNS/ {s/^#//;s/yes/no/}' /etc/ssh/sshd_config

curl -o /etc/yum.repos.d/163.repo http://mirrors.163.com/.help/CentOS7-Base-163.repo &>/dev/null

curl -o /etc/yum.repos.d/epel.repo http://mirrors.aliyun.com/repo/epel-7.repo

yum -y install ntpdate

ntpdate -b ntp1.aliyun.com

# 2.設置Hostname解析

hostnamectl set-hostname elk-1

## 修改/etc/hosts 增加如下內容

192.168.144.131 elk-1

# 4.java安裝

# rpm -ivh jdk-8u121-linux-x64.rpm

# 如果使用rpm請到/etc/profile加上

# JAVA_HOME=/usr/java/jdk1.8.0_121

# export PATH=$PATH:$JAVA_HOME/bin

yum -y install java-1.8.0-openjdk.x86_64

# 5.創建用戶和組並準備相關目錄並授權

groupadd elk

useradd elk -g elk

mkdir -pv /data/elk/{data,logs}

chown -R elk:elk /data/elk/

# 6.軟件包解壓、授權

# 上傳軟件包

通過scp 或者FTP方式上傳到/opt下

# 解壓軟件包到/opt目錄

tar xvf elasticsearch-7.2.0-linux-x86_64.tar.gz -C /opt/

# 授權

chown -R elk:elk /opt/elasticsearch-7.2.0/ # 軟件包名

# 7.修改elk配置文件

[root@elk-1 ~]# vim /opt/elasticsearch-7.2.0/config/elasticsearch.yml

# 集群名

cluster.name: elk

# 節點名

node.name: node-1

# 存儲數據

path.data: /data/elk/data

# 存放日誌

path.logs: /data/elk/logs

# 鎖內存,盡量不使用交換內存

bootstrap.memory_lock: false

# 網絡地址

network.host: 0.0.0.0

http.port: 9200

# 發現集群hosts

discovery.seed_hosts: ["elk-1"]

# 設置集群master節點

cluster.initial_master_nodes: ["node-1"]

# 8.修改/etc/security/limits.conf

# *號不是註釋

* soft nproc 65535

* hard nproc 65535

* soft nofile 65535

* hard nofile 65535

ulimit -n 65535

ulimit -u 20480

# 9.修改/etc/sysctl.conf

echo "vm.max_map_count=262144" >> /etc/sysctl.conf

sysctl -p

# 10.啟動ES並檢查集群健康狀態

nohup runuser -l elk -c '/bin/bash /opt/elasticsearch-7.2.0/bin/elasticsearch' &

# 這裏為了省事直接用的nohup 可以使用supervisord 對進程進行管理

[root@elk-1 ~]# curl -XGET 'elk-1:9200/_cluster/health?pretty'

{

"cluster_name" : "elk",

"status" : "green",

"timed_out" : false,

"number_of_nodes" : 1,

"number_of_data_nodes" : 1,

"active_primary_shards" : 0,

"active_shards" : 0,

"relocating_shards" : 0,

"initializing_shards" : 0,

"unassigned_shards" : 0,

"delayed_unassigned_shards" : 0,

"number_of_pending_tasks" : 0,

"number_of_in_flight_fetch" : 0,

"task_max_waiting_in_queue_millis" : 0,

"active_shards_percent_as_number" : 100.0

}

Kibana安裝

# 1.解壓Kibana安裝包

tar xvf kibana-7.2.0-linux-x86_64.tar.gz -C /opt/

# 2.修改Kibana配置文件

server.port: 5601 # Port

server.host: 0.0.0.0 # 訪問限制

elasticsearch.hosts: ["http://192.168.144.131:9200"] # ES主機IP:Port

# 3.啟動命令

[root@kibana ~]# nohup /opt/kibana-7.2.0-linux-x86_64/bin/kibana --allow-root &

[1] 14650

# tailf nohup.out 即可實時查看日誌

Logstash安裝

[root@kibana ~]# rpm -ivh jdk-8u121-linux-x64.rpm

[root@kibana ~]# tar xvf logstash-7.2.0.tar.gz -C /opt/

[root@kibana opt]# vim /opt/nginx.yml

# Sample Logstash configuration for creating a simple

# # Beats -> Logstash -> Elasticsearch pipeline.

#

input {

beats {

port => 5044

}

}

filter {

grok {

match => ["message","%{DATA:log_date} %{WORD:method} %{TIME:log_localtime} %{HOSTNAME:host_name} %{WORD:workd}\[%{WORD:ls}\]\: %{DATA:log_date} %{TIME:log_localtime2} %{WORD:year_tmp}\: %{WORD:name_2}\: %{WORD:request_leixin} %{WORD:request_num}\, %{WORD}\: %{WORD:app_id}\, %{WORD}\: %{IP:ip}\, %{WORD}\: %{INT}\, %{WORD}\: %{USERNAME:device_id}"]

}

}

output {

elasticsearch {

hosts => ["http://192.168.144.131:9200"]

index => "app_log-%{[@metadata][beat]}-%{[@metadata][version]}-%{+YYYY.MM.dd}"

}

}

# 啟動 (如果起不來或者報錯一般都是配置文件語法錯誤之類的)

/opt/logstash-7.2.0/bin/logstash -f /opt/配置文件名.yml

## 後台運行

nohup /opt/logstash-7.2.0/bin/logstash -f /opt/配置文件名.yml &

Filebeat安裝

# 安裝filebeat RPM包

[root@filebeat ~]# rpm -ivh filebeat-7.2.0-x86_64.rpm

# 修改配置文件:

Filebeat到Logstash

(vim /etc/filebeat/filebeat.yml) shift + : 輸入set nu 显示行號

24: enabled: true # 更改為true以啟用輸入配置

28: - /data/*.log # 替換為要抓取的日誌文件路徑,如果抓取nginx日誌,修改為/var/log/nginx/access.log,如果是日誌服務器,在下面再加上多行其他地方的日誌目錄即可

73: reload.enabled: true # 啟動Filebeat模塊

148: output.elasticsearch: # 加上註釋;

150: hosts: ["localhost:9200"] # 加上註釋;

158: output.logstash: # 去掉註釋;

160: hosts: ["192.168.144.128<logstash>:5044"] # 去掉註釋,並修改localhost為logstash機器IP及對應端口號;

# 測試配置文件並啟動

filebeat test config -e

systemctl start filebeat && systemctl enable filebeat

[root@filebeat ~]# cat /data/nginx.log # 創建該目錄及文件,加入兩行日誌.

Sep 2 16:00:18 cc-prd-3-tk-13-pcs1 pcs[16118]: Mon Sep 2 16:00:18 2019: PCS: recv request, app_id: app_1w5B6O4R2o1k881k12177, ip: 223.104.145.136, os: 0, device_id: 02c3864050502d43dc514905133bcc9c

Sep 2 16:00:18 cc-prd-3-tk-13-pcs1 pcs[16118]: Mon Sep 2 16:00:18 2019: PCS: recv request, app_id: app_1w5B6O4R2o1k881k12177, ip: 223.104.145.136, os: 0, device_id: 02c3864050502d43dc514905133bcc9c

收集的日誌需要把有用的信息做切割,讓相應字段成為獨立的個一個字段,而不是一整條日誌是一個字段,那樣就沒法做分析,而做數據源切割很重要,否則日誌會過不來,或者日誌做不了分析,統計.

可以把源日誌拿到kibana上的grok上做切割,直到Structured Data能出現你想要的字段就可以放到logstash的配置文件中

本站聲明:網站內容來源於博客園,如有侵權,請聯繫我們,我們將及時處理

【其他文章推薦】

※USB CONNECTOR掌控什麼技術要點? 帶您認識其相關發展及效能

※台北網頁設計公司這麼多該如何選擇?

※智慧手機時代的來臨,RWD網頁設計為架站首選

※評比南投搬家公司費用收費行情懶人包大公開

※回頭車貨運收費標準