本站聲明:網站內容來源於EnergyTrend https://www.energytrend.com.tw/ev/,如有侵權,請聯繫我們,我們將及時處理

【其他文章推薦】

※為什麼 USB CONNECTOR 是電子產業重要的元件?

※網頁設計一頭霧水該從何著手呢? 台北網頁設計公司幫您輕鬆架站!

※台北網頁設計公司全省服務真心推薦

※想知道最厲害的網頁設計公司“嚨底家”!

※推薦評價好的iphone維修中心

※聚甘新

|

特斯拉執行長馬斯克(Elon Musk)再發豪語,宣稱旗下電動車在2017年底,就能具備自動駕駛功能,一路從洛杉磯開到紐約。Seeking Alpha網站認為,特斯拉有信心在短時間內開發出自動駕駛系統,得歸功於Nvidia。

Seeking Alpha 24日報導,特斯拉原本與以色列商Mobileye合作,採用EyeQ3晶片,旗下電動車具備自動緊急煞車、碰撞警示、維持車道等功能,不過特斯拉和Mobileye分手,改採Nvidia系統之後,原有的先進駕駛輔助系統(ADAS)全部泡湯。

既然如此,特斯拉為何敢放話明年底就有自動駕駛?文章稱,Nvidia研發出革命性的自駕系統,該公司蒐集人類實際開車影片,搭配方向盤的操控角度,用來訓練類神經網路(Neural Network、NN);也就是說,每一格駕駛畫面,都有正確答案,讓NN學會打方向盤的角度;再搭配偏離車道時,如何修正重回線道的資料等,讓電腦掌握開車技巧。

這個方式的特點在於,NN能「全面」掌握駕駛技術。在此之前,業者多把自駕細分成多個項目,如辨識物體、道路等,接著再加以結合,無法確認電腦是否真的完全抓到開車訣竅。Nvidia這套新方法簡單快速,不到一年就有極佳成效,汽車能在多種狀況下自動駕駛(影片見此),如果以此一系統為基礎,應能迅速讓自駕功力大增。文章猜測,特斯拉正是相中此點,才捨棄舊愛Mobileye、改和Nvidia合作。

文章指稱,特斯拉運用Nvidia技術開發出自駕車模型,能從人類實際開車情況和反應中學習,加快研發進展。然而該文警告,問題是機器學習不知道什麼時候會碰上瓶頸,以為NN能就此一帆風順學會開車,過於樂觀。自駕車門檻極高,NN學習過程或許會陷入停滯,難以達標。該文指出,目前谷歌自駕車的開車技術仍不如人類,特斯拉更是遠遠落後。

BusinessInsider報導,特斯拉(Tesla Motors Inc.)執行長(CEO)馬斯克(Elon Musk)19日在記者會上表示,2017年底特斯拉旗下車種將可啟動無人駕駛模式、自洛杉磯開到紐約時代廣場。馬斯克今年初曾表示,特斯拉自駕車將可在2018年橫越美國。他在19日的媒體發表會上提到,特斯拉自駕車的安全性比人類駕駛要高出一倍或更多,硬體基礎已經都準備妥當,只待軟體以及相關法規到位。

特斯拉10月19日發布新聞稿宣布,即日起出廠的旗下所有電動車(包括Model 3)都將配備全自動駕駛硬體配件。特斯拉指出,自駕功能將令車輛安全性大幅提高。

特斯拉新出廠車款配備8個鏡頭、具有360度視角,可視距離達250公尺;12個新版超音波感測器將可進一步提升車輛視覺能力、使得軟硬物件偵測距離較前一代提升一倍。具有增強處理效能的前向雷達可讓車輛掌握前方的車輛動向以及大雨、霧、灰塵等路況。

(本文由授權提供。照片來源:shared by CC 2.0)

本站聲明:網站內容來源於EnergyTrend https://www.energytrend.com.tw/ev/,如有侵權,請聯繫我們,我們將及時處理

【其他文章推薦】

※帶您來了解什麼是 USB CONNECTOR ?

※自行創業缺乏曝光? 網頁設計幫您第一時間規劃公司的形象門面

※如何讓商品強力曝光呢? 網頁設計公司幫您建置最吸引人的網站,提高曝光率!

※綠能、環保無空污,成為電動車最新代名詞,目前市場使用率逐漸普及化

※廣告預算用在刀口上,台北網頁設計公司幫您達到更多曝光效益

※教你寫出一流的銷售文案?

※聚甘新

|

美國電動車商特斯拉(Tesla)於10月26日發表今年第三季財報,以淨營收2,190萬美元的成果翻紅,EPS相當於每股0.14美元。全球電動車市場蓬勃,且Model 3車款的訂單爆量,市況前景佳,也帶動了上游的供應鏈興盛。為特斯拉車用電池供應原料的日本住友金屬礦山(Sumitomo Metal Mining)也宣布將擴大產能。

特斯拉轉盈

特斯拉今年第三季的淨營收為2,190萬美元,EPS每股0.14美元,較去年每股虧損1.78美元有大幅成長。經會計調整後,第三季EPS為0.71美元,遠高於原先路透社調查預估的虧損0.54美元。會計調整後營收23億美元,也優於原先法人預期的19.8億美元。

特斯拉執行長Elon Musk在財報說明會上表示,今年下半年仍力求出貨5萬輛電動車的目標,並將致力於提升毛利率;在此基礎下,Musk看好第四季營收仍將持續獲利。

特斯拉亦指出,Model 3的交車時間表仍在軌道上,相當於駁斥Model 3將會面臨交車延遲的市場傳聞。特斯拉第三季財報的表現,也將影響股東於11月17日的股東會上針對是否併購SolarCity之投票案的意願。

特斯拉訂單多,上游樂

特斯拉的車用電池由Panasonic提供,而Panasonic的鋰離子電池其中一項原料──鎳酸鋰,則幾乎都由日本住友金屬礦山供應。因應特斯拉訂單強勁,以及全球電動車需求成長,住友金屬礦山宣布砸下180億日圓資金,擴大鎳酸鋰產能。

住友金屬礦山目前的鎳酸鋰每月產能約為1,850噸,預計在2018年1月擴產至3,550噸,以供應未來電動車用鋰電池所需。同時,住友金屬礦山也與Panasonic合作研發高性能鎳酸鋰的產能。

住友金屬礦山的擴產計畫,與特斯拉預計在2017年開始出貨Model 3有直接關聯。加上特斯拉預計2018年要出貨50萬輛Model 3,住友金屬礦山也因此將原先擴產到2,550噸的計畫提高到3,550噸。

其他鋰電池材料,如正負極、分隔膜、電解液等,日系、韓系廠商如住友化學、Toray、旭化成、昭和電工等的市占率相當高。這些廠商也都看好電動車市場的需求繼續成長,持續有擴產計畫,並與鋰電池大廠Panasonic、LG Chem等公司密切合作。

(照片來源: shared by CC 2.0)

本站聲明:網站內容來源於EnergyTrend https://www.energytrend.com.tw/ev/,如有侵權,請聯繫我們,我們將及時處理

【其他文章推薦】

※為什麼 USB CONNECTOR 是電子產業重要的元件?

※網頁設計一頭霧水該從何著手呢? 台北網頁設計公司幫您輕鬆架站!

※台北網頁設計公司全省服務真心推薦

※想知道最厲害的網頁設計公司“嚨底家”!

※推薦評價好的iphone維修中心

※聚甘新

一般的電動車用電池約有7~8 年的使用壽命,但因含有鋰、硫酸等重金屬,若無妥善回收處理,將有環境汙染之虞。香港政府所引入的首批電動車之電池屆臨退役,專家呼籲政府盡速制訂回收辦法,以避免更嚴重的環境破壞。

香港《蘋果日報》報導,香港在豁免電動車首次登記稅後,電動車數量急速從2010年的100輛以下成長到今年8月的6,167輛,其中以Tesla和Volkswagen最受歡迎。以一般電動車用電池約7年的平均壽命來看,香港首批電動車的舊電池已屆臨汰役,但香港目前仍無回收制度;若廢電池隨意丟棄,所造成的重金屬汙染恐怕較傳統柴油車和汽油車更嚴重,完全背離環保的美意。

香港汽車會副會長李耀培表示,車用電池的儲電量若降低到70%,就可能影響電動車行動速度,甚至造成熄火,進而影響行車安全,因此在此階段就會汰役換新。不過,這也意味著汰役的車用電池其實仍有70%的蓄電量,經妥善處理後可進行二次運用。

報導指出,香港過去會將這類廢電池交給有牌照的化學廢物處置設施進行初步處理,之後再出口到海外回收。但李耀培表示,這只是把汙染丟出香港,並沒有解決問題。他呼籲政府應制定長遠的回收機制,或可參考英國、歐洲等國家將汰役的電動車用電池改製為風力、太陽能儲能設備,更能有效利用電池,且也有助環保。

本站聲明:網站內容來源於EnergyTrend https://www.energytrend.com.tw/ev/,如有侵權,請聯繫我們,我們將及時處理

【其他文章推薦】

※USB CONNECTOR掌控什麼技術要點? 帶您認識其相關發展及效能

※台北網頁設計公司這麼多該如何選擇?

※智慧手機時代的來臨,RWD網頁設計為架站首選

※評比南投搬家公司費用收費行情懶人包大公開

※回頭車貨運收費標準

※聚甘新

首先是個人的一些閱讀源碼的小技巧,不一定適用每個人,可以直接跳過。

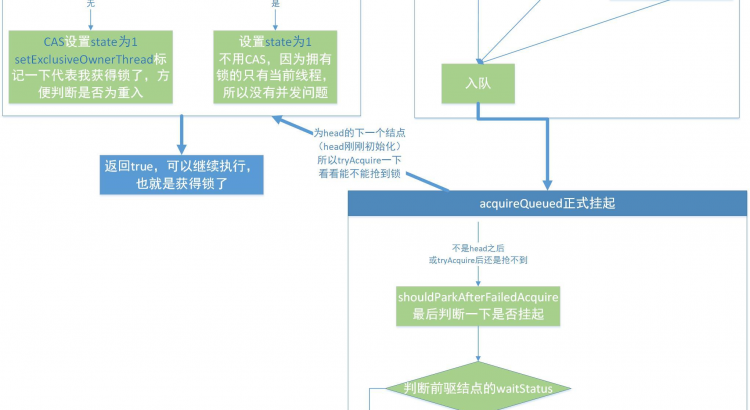

個人覺得大多數情況下跟着一篇優秀的博客配合著看就足夠了,之後再自己寫博客總結一遍加深印象,畫一下流程圖基本都能理順。(圖為學AQS時本人畫的獲取獨佔鎖流程圖)

配合idea看類之間的關係(ctrl+alt+shift+u)的功能也能更好的理解整個項目的整體架構。因為很多源碼其實並不是真的複雜,只是為了擴展性優雅簡潔等原因建立了大量的接口和抽象類以及各種設計模式,使得項目看起來很龐大很複雜,藉助這個功能有利於你排除掉一些你暫時不想去關心的設計邏輯。知道那個部分才是最核心的邏輯,專註於去看核心代碼。

但是如果你看的博客裏面剛好缺少了一部分你想看的內容,而你又找不到資料,需要自己去看,又或者你想看的源碼一點點資料都找不到的情況下想去看源碼。

這個時候比較有作用的就是註釋,源碼中的註釋看不懂也沒關係,放到百度翻譯里基本也能理解大概的意思。仔細看完方法或類的註釋之後你就理解了接下來這個類大致是在做什麼,之後讀它的源碼會通順很多,有一些方法或類甚至在你看完註釋之後就已經能知道你想看的內容了,已經沒有需要繼續往下讀了。

不僅僅是類或方法的註釋文檔,方法中代碼的註釋也很重要,基本上稍微複雜一點點的代碼,甚至有時候加個鎖,作者都會認認真真的寫一行註釋解釋自己這麼做的原因。

還有一點是適當忽略一些不重要的細節,這個主要看你想看什麼,一般我們看第一遍大多數只是想知道大致的流程是什麼樣的,所以可以適當忽略併發邏輯和一些方法里的內容(看一眼註釋先知道這個方法會做什麼的就夠了)。第一遍大致知道流程,第二第三遍再去深究細節和併發邏輯等。

多用debug,很多時候源碼走的路線會和你想象中的有很大不同,你以為會進入這個if,其實他偷偷進了else。

經常看到利用短路機制的代碼,這裏以 AbstractQueuedSynchronizer 的 acquire 方法為例子,只有 tryAcquire 獲取鎖失敗, !tryAcquire 返回 true 時才會執行後面進入阻塞隊列並掛起的方法,如果獲取鎖成功了,根據短路機制自然不會執行入隊方法。

// AbstractQueuedSynchronizer.acquire(int arg) if (!tryAcquire(arg) && acquireQueued(addWaiter(Node.EXCLUSIVE), arg)) { selfInterrupt(); }

ReentrantReadWriteLock的這段代碼里將AQS的state一分為二給共享鎖和獨佔鎖使用,個人覺得這種設計非常巧妙:

// ReentrantReadWriteLock abstract static class Sync extends AbstractQueuedSynchronizer { // 下面這塊說的就是將 state 一分為二,高 16 位用於共享模式,低16位用於獨佔模式 static final int SHARED_SHIFT = 16; static final int SHARED_UNIT = (1 << SHARED_SHIFT); static final int MAX_COUNT = (1 << SHARED_SHIFT) - 1; static final int EXCLUSIVE_MASK = (1 << SHARED_SHIFT) - 1; // 取 c 的高 16 位值,代表讀鎖的獲取次數(包括重入) static int sharedCount(int c) { return c >>> SHARED_SHIFT; } // 取 c 的低 16 位值,代表寫鎖的重入次數,因為寫鎖是獨佔模式 static int exclusiveCount(int c) { return c & EXCLUSIVE_MASK; }

忘記在哪裡看到的了,翻了一下瀏覽記錄應該是在Java AIO部分的源碼里,這種寫法感覺很簡潔就記下來了,不過可讀性似乎不太高,特別是第一種乍一看還以為是lambda表達式

意思等同於 for (int i = 0; i < n; i++) ,但是 while(n– > 0) 和 while (–n >= 0) 這種寫法會直接改變n的值

在很多jdk的源碼中我們都可以看到 xx = null // help GC 這樣的代碼,用來置空引用,幫助jvm完成gc。具體可以了解可達性算法。

這裏我們以LinkList為例子:

// LinkList 的方法 private E unlinkFirst(Node<E> f) { final E element = f.item; final Node<E> next = f.next; f.item = null; f.next = null; // help GC first = next; if (next == null) last = null; else next.prev = null; size--; modCount++; return element; }

在很多地方都會使用位移來進行運算,平時寫算法題也一樣很多人都這麼使用,下面以 ArrayList 的 grow 方法為例子,這裏通過右移1位使 oldCapacity 變為原來的0.5倍,之後加上它本身得到 newCapacity

// ArrayList.grow(int minCapacity) private void grow(int minCapacity) { // . . . . . . int newCapacity = oldCapacity + (oldCapacity >> 1);//newCapacity就是1.5倍的oldCapacity // . . . . . . }

以上是我目前的水平所能總結出來的,後續學到其他的會繼續更新,如果大家有什麼補充的請告訴我

最後慣例附一圖:(根本不存在想雇傭我的地方( ´_ゝ`).jpg)

本站聲明:網站內容來源於博客園,如有侵權,請聯繫我們,我們將及時處理

【其他文章推薦】

※帶您來了解什麼是 USB CONNECTOR ?

※自行創業缺乏曝光? 網頁設計幫您第一時間規劃公司的形象門面

※如何讓商品強力曝光呢? 網頁設計公司幫您建置最吸引人的網站,提高曝光率!

※綠能、環保無空污,成為電動車最新代名詞,目前市場使用率逐漸普及化

※廣告預算用在刀口上,台北網頁設計公司幫您達到更多曝光效益

※教你寫出一流的銷售文案?

※聚甘新

目錄

我們知道在JVM中為了加快編譯速度,引入了JIT即時編譯的功能。那麼JIT什麼時候開始編譯的,又是怎麼編譯的,作為一個高傲的程序員,有沒有辦法去探究JIT編譯的秘密呢?答案是有的,今天和小師妹一起帶大家來看一看這個編譯背後的秘密。

更多精彩內容且看:

小師妹:F師兄,JIT這麼神器,但是好像就是一個黑盒子,有沒有辦法可以探尋到其內部的本質呢?

追求真理和探索精神是我們作為程序員的最大優點,想想如果沒有玻爾關於原子結構的新理論,怎麼會有原子體系的突破,如果沒有海森堡的矩陣力學,怎麼會有量子力學的建立?

JIT的編譯日誌輸出很簡單,使用 -XX:+LogCompilation就夠了。

如果要把日誌重定向到一個日誌文件中,則可以使用-XX:LogFile= 。

但是要開啟這些分析的功能,又需要使用-XX:+UnlockDiagnosticVMOptions。 所以總結一下,我們需要這樣使用:

-XX:+UnlockDiagnosticVMOptions -XX:+LogCompilation -XX:LogFile=www.flydean.com.log

根據上面的介紹,我們現場來生成一個JIT的編譯日誌,為了體現出專業性,這裏我們需要使用到JMH來做性能測試。

JMH的全稱是Java Microbenchmark Harness,是一個open JDK中用來做性能測試的套件。該套件已經被包含在了JDK 12中。

如果你使用的不是JDK 12,那麼需要添加如下依賴:

<dependency>

<groupId>org.openjdk.jmh</groupId>

<artifactId>jmh-core</artifactId>

<version>1.19</version>

</dependency>

<dependency>

<groupId>org.openjdk.jmh</groupId>

<artifactId>jmh-generator-annprocess</artifactId>

<version>1.19</version>

</dependency>

更多詳情可以參考我之前寫的: 在java中使用JMH(Java Microbenchmark Harness)做性能測試一文。

之前有的朋友說,代碼也用圖片,看起來好看,從本文之後,我們會盡量把代碼也轉成圖片來展示:

看完我的JMH的介紹,上面的例子應該很清楚了,主要就是做一個累加操作,然後warmup 5輪,測試5輪。

在@Fork註解裏面,我們可以配置jvm的參數,為什麼我註釋掉了呢?因為我發現在jvmArgsPrepend中的-XX:LogFile是不生效的。

沒辦法,我只好在運行配置中添加:

運行之後,你就可以得到輸出的編譯日誌文件。

小師妹:F師兄,我看了一下生成的文件好複雜啊,用肉眼能看得明白嗎?

別怕,只是內容的多一點,如果我們細細再細細的分析一下,你會發現其實它真的非常非常……複雜!

其實寫點簡單的小白文不好嗎?為什麼要來分析這麼複雜,又沒人看,看了也沒人懂的JVM底層…..

大概,這就是專業吧!

LogCompilation文件其實是xml格式的,我們現在來大概分析一下,它的結構,讓大家下次看到這個文件也能夠大概了解它的重點。

首先最基本的信息就是JVM的信息,包括JVM的版本,JVM運行的參數,還有一些properties屬性。

我們收集到的日誌其實是分兩類的,第一類是應用程序本身的的編譯日誌,第二類就是編譯線程自己內部產生的日誌。

第二類的日誌會以hs_c*.log的格式存儲,然後在JVM退出的時候,再將這些文件跟最終的日誌輸出文件合併,生成一個整體的日誌文件。

比如下面的兩個就是編譯線程內部的日誌:

<thread_logfile thread='22275' filename='/var/folders/n5/217y_bgn49z18zvjch907xb00000gp/T//hs_c22275_pid83940.log'/>

<thread_logfile thread='41731' filename='/var/folders/n5/217y_bgn49z18zvjch907xb00000gp/T//hs_c41731_pid83940.log'/>

上面列出了編譯線程的id=22275,如果我們順着22275找下去,則可以找到具體編譯線程的日誌:

<compilation_log thread='22275'>

...

</compilation_log>

上面由compilation_log圍起來的部分就是編譯日誌了。

接下來的部分表示,編譯線程開始執行了,其中stamp表示的是啟動時間,下圖列出了一個完整的編譯線程的日誌:

<start_compile_thread name='C2 CompilerThread0' thread='22275' process='83940' stamp='0.058'/>

接下來描述的是要編譯的方法信息:

<task compile_id='10' method='java.lang.Object <init> ()V' bytes='1' count='1409' iicount='1409' stamp='0.153'>

上面列出了要編譯的方法名,compile_id表示的是系統內部分配的編譯id,bytes是方法中的字節數,count表示的是該方法的調用次數,注意,這裏的次數並不是方法的真實調用次數,只能做一個估計。

iicount是解釋器被調用的次數。

task執行了,自然就會執行完成,執行完成的內容是以task_done標籤來表示的:

<task_done success='1' nmsize='120' count='1468' stamp='0.155'/>

其中success表示是否成功執行,nmsize表示編譯器編譯出來的指令大小,以byte為單位。如果有內聯的話,還有個inlined_bytes屬性,表示inlined的字節個數。

<type id='1025' name='void'/>

type表示的是方法的返回類型。

<klass id='1030' name='java.lang.Object' flags='1'/>

klass表示的是實例和數組類型。

<method id='1148' holder='1030' name='<init>' return='1025' flags='1' bytes='1' compile_id='1' compiler='c1' level='3' iicount='1419'/>

method表示執行的方法,holder是前面的klass的id,表示的是定義該方法的實例或者數組對象。method有名字,有

return,return對應的是上面的type。

flags表示的是方法的訪問權限。

接下來是parse,是分析階段的日誌:

<parse method='1148' uses='1419.000000' stamp='0.153'>

上面有parse的方法id。uses是使用次數。

<bc code='177' bci='0'/>

bc是byte Count的縮寫,code是byte的個數,bci是byte code的索引。

<dependency type='no_finalizable_subclasses' ctxk='1030'/>

dependency分析的是類的依賴關係,type表示的是什麼類型的依賴,ctkx是依賴的context class。

我們注意有的parse中,可能會有uncommon_trap:

<uncommon_trap bci='10' reason='unstable_if' action='reinterpret' debug_id='0' comment='taken never'/>

怎麼理解uncommon_trap呢?字面上意思就是捕獲非常用的代碼,就是說在解析代碼的過程中發現發現這些代碼是uncommon的,然後解析產生一個uncommon_trap,不再繼續進行了。

它裏面有兩個比較重要的字段,reason表示的是被標記為uncommon_trap的原因。action表示的出發uncommon_trap的事件。

有些地方還會有call:

<call method='1150' count='5154' prof_factor='1.000000' inline='1'/>

call的意思是,在該代碼中將會調用其他的方法。count是執行次數。

複雜的編譯日誌終於講完了,可能講的並不是很全,還有一些其他情況這裏並沒有列出來,後面如果遇到了,我再添加進去。

本文的例子https://github.com/ddean2009/learn-java-base-9-to-20

本文作者:flydean程序那些事

本文鏈接:http://www.flydean.com/jvm-jit-logcompilation/

本文來源:flydean的博客

歡迎關注我的公眾號:程序那些事,更多精彩等着您!

本站聲明:網站內容來源於博客園,如有侵權,請聯繫我們,我們將及時處理

【其他文章推薦】

※為什麼 USB CONNECTOR 是電子產業重要的元件?

※網頁設計一頭霧水該從何著手呢? 台北網頁設計公司幫您輕鬆架站!

※台北網頁設計公司全省服務真心推薦

※想知道最厲害的網頁設計公司“嚨底家”!

※推薦評價好的iphone維修中心

※聚甘新

在開始本文之前,真的好想做個問卷調查,到底有多少人和我一樣,對 JsonConvert 的認識只局限在 SerializeObject 和 DeserializeObject 這兩個方法上(┬_┬), 這樣我也好結伴同行,不再孤單落魄,或許是這兩個方法基本上能夠解決工作中 80% 的場景,對於我來說確實是這樣,但隨着編碼的延續,終究還是會遇到那剩下的 20% ,所以呀。。。

我的場景是這樣的:前段時間寫業務代碼的時候,我有一個自定義的客戶算法類型的Model,這個Model中有這種算法類型下的客戶群以及Report統計信息,還用了 HashSet 記錄了該類型下的 CustomerID集合,為了方便講述,我把Model簡化如下:

class CustomerAlgorithmModel

{

public string DisplayName { get; set; }

public int CustomerType { get; set; }

public ReprotModel Report { get; set; }

public HashSet<int> CustomerIDHash { get; set; }

}

class ReprotModel

{

public int TotalCustomerCount { get; set; }

public int TotalTradeCount { get; set; }

}

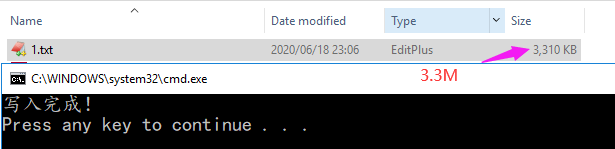

那有意思的就來了,我個人是有記日誌的癖好,就想着以後不會出現死無對證的情況,然後就理所當然的使用 JsonConvert.SerializeObject, 這一下就出問題了,日誌送入到了 ElasticSearch ,然後通過 Kibana 查不出來,為啥呢? 看完上面的 Model 我想你也猜到了原因,json體太大了哈,好歹 CustomerIDHash 中也有幾十萬個撒,這一下全導出成json了,這 size 還能小嗎? 要不我寫段代碼看一看。

static void Main(string[] args)

{

var algorithModel = new CustomerAlgorithmModel()

{

CustomerType = 1,

DisplayName = "",

Report = new ReprotModel()

{

TotalCustomerCount = 1000,

TotalTradeCount = 50

},

CustomerIDHash = new HashSet<int>(Enumerable.Range(1, 500000))

};

var json = JsonConvert.SerializeObject(algorithModel);

File.WriteAllText("1.txt", json, Encoding.UTF8);

Console.WriteLine("寫入完成!");

}

可以看到,僅一個json就 3.3M,這樣的記錄多來幾打后,在 kibana 上一檢索,瀏覽器就卡的要死,其實 CustomerIDHash 這個字段對我來說是可有可無的,就算存下來了也沒啥大用,所以需求就來了,如何屏蔽掉 CustomerIDHash。

有問題就網上搜啊,這一搜馬上就有人告訴你可以使用 JsonIgnoreAttribute 忽略特性,加好這個特性後繼續跑一下程序。

[Newtonsoft.Json.JsonIgnore]

public HashSet<int> CustomerIDHash { get; set; }

太好了,終於搞定了,但是靜下心來想一想,總感覺心裏有那麼一點不舒服,為什麼這麼說,一旦你給這個 CustomerIDHash 套上了 JsonIgnore ,這就意味着它在 JsonConvet 的世界中從此消失,也不管是誰在使用這個Model, 但這並不是我的初衷,我的初衷僅僅是為了在記錄日誌的時候踢掉 CustomerIDHash,可千萬不要影響在其他場景下的使用哈,現在這種做法就會給自己,給別人挖坑,埋下了不可預知的bug,我想你應該明白我的意思,還得繼續尋找下一個方案。

真的,Newtonsoft 太強大了,我都想寫一個專題好好彌補彌補我的知識盲區,其實在這個場景中不就是想把 HashSet<int> 給屏蔽掉嘛,Newtonsoft 中專門提供了一個針對特定類型的自定義處理類,接下來我就寫一段:

/// <summary>

/// 自定義一個 針對 HashSet<int> 的轉換類

/// </summary>

public class HashSetConverter : Newtonsoft.Json.JsonConverter<HashSet<int>>

{

public override HashSet<int> ReadJson(JsonReader reader, Type objectType, HashSet<int> existingValue, bool hasExistingValue, JsonSerializer serializer)

{

return existingValue;

}

public override void WriteJson(JsonWriter writer, HashSet<int> value, JsonSerializer serializer)

{

writer.WriteNull();

}

}

就是這麼簡單,然後就可以在 SerializeObject 的時候指定下自定義的 HashSetConverter 即可,然後再將程序跑起來看一下。

var json = JsonConvert.SerializeObject(algorithModel, Formatting.Indented, new HashSetConverter());

從圖中看,貌似也是解決了,但我突然發現自己要鑽牛角尖了,如果我的實體中又來了一個頂級優質客戶群的 TopNCustomerIDHash,但因為這個CustomerID 比較少,我希望在 Json 中能保留下來,然後就是踢掉的那個 CustomerIDHash 我要保留 CustomerIDHash.Length ,哈哈,搞事情哈,那接下來怎麼解決呢?

class CustomerAlgorithmModel

{

public HashSet<int> CustomerIDHash { get; set; }

// topN 優質客戶群

public HashSet<int> TopNCustomerIDHash { get; set; }

}

public override void WriteJson(JsonWriter writer, HashSet<int> value, JsonSerializer serializer)

{

if (writer.Path == "TopNCustomerIDHash")

{

writer.WriteStartArray();

foreach (var item in value)

{

writer.WriteValue(item);

}

writer.WriteEndArray();

}

else

{

writer.WriteValue(value.Count);

}

}

var algorithModel = new CustomerAlgorithmModel()

{

CustomerType = 1,

DisplayName = "",

Report = new ReprotModel()

{

TotalCustomerCount = 1000,

TotalTradeCount = 50

},

CustomerIDHash = new HashSet<int>(Enumerable.Range(1, 500000)),

TopNCustomerIDHash = new HashSet<int>(Enumerable.Range(1, 10)),

};

三塊都搞定后就可以把程序跑起來了,如下圖:

貌似鑽牛角尖的問題是解決了,既然鑽牛角尖肯定要各種鄙視,比如這裏的 ReportModel 我是不需要的,CustomerType 我也是不需要的,我僅僅需要看一下 DisplayName 和 TotalCustomerCount 這兩個字段就可以了, 那這個要怎麼解決呢?

確實很多時候記日誌,就是為了跟蹤 Model 中你特別關心的那幾個字段,所以摻雜了多餘的字段確實也是沒必要的,這裏可以用匿名來解決,我就來寫一段代碼:

var json = JsonConvert.SerializeObject(new

{

algorithModel.DisplayName,

algorithModel.Report.TotalCustomerCount

}, Formatting.Indented);

雖然阻擊了幾個回合,但同時也發現了 Newtonsoft 中還有特別多的未挖掘功能,真的需要好好研究研究,源碼已下好,接下來準備做個系列來解剖一下,值得一提的是 .Net中已自帶了 System.Text.Json.JsonSerializer 類,目前來看功能還不算太豐富,簡單用用還是可以的,本篇就說到這裏,希望對您有幫助。

本站聲明:網站內容來源於博客園,如有侵權,請聯繫我們,我們將及時處理

【其他文章推薦】

※USB CONNECTOR掌控什麼技術要點? 帶您認識其相關發展及效能

※台北網頁設計公司這麼多該如何選擇?

※智慧手機時代的來臨,RWD網頁設計為架站首選

※評比南投搬家公司費用收費行情懶人包大公開

※回頭車貨運收費標準

※聚甘新

VUE+Element 前端是一個純粹的前端處理,前面介紹了很多都是Vue+Element開發的基礎,從本章隨筆開始,就需要進入深水區了,需要結合ABP框架使用(如果不知道,請自行補習一下我的隨筆:ABP框架使用),ABP框架作為後端,是一個非常不錯的技術方向,但是前端再使用Asp.NET 進行開發的話,雖然會快捷一點,不過可能顯得有點累贅了,因此BS的前端選項採用Vue+Element來做管理(後續可能會視情況加入Vue+AntDesign),CS前端我已經完成了使用Winform+ABP的模式了。本篇隨筆主要介紹Vue+Element+ABP的整合方式,先從登錄開始介紹。

ABP是ASP.NET Boilerplate的簡稱,ABP是一個開源且文檔友好的應用程序框架。ABP不僅僅是一個框架,它還提供了一個最徍實踐的基於領域驅動設計(DDD)的體繫結構模型。

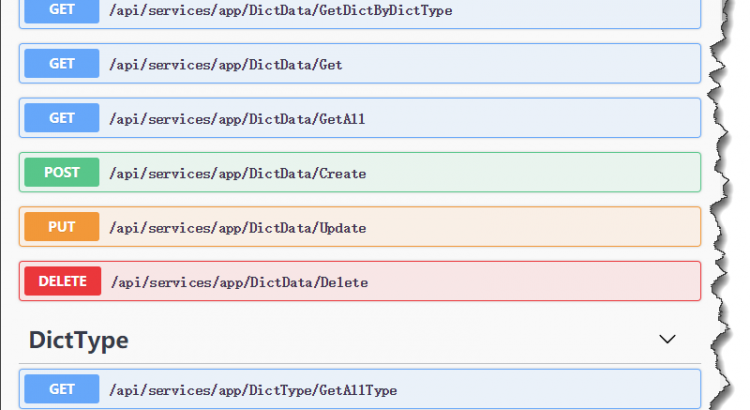

啟動Host的項目,我們可以看到Swagger的管理界面如下所示。

我們登錄獲得用戶訪問令牌token后,測試字典類型或者字典數據的接口,才能返迴響應的數據。

我根據ABP後端項目之間的關係,整理了一個架構的圖形。

應用服務層是整個ABP框架的靈魂所在,對內協同倉儲對象實現數據的處理,對外配合Web.Core、Web.Host項目提供Web API的服務,而Web.Core、Web.Host項目幾乎不需要進行修改,因此應用服務層就是一個非常關鍵的部分,需要考慮對用戶登錄的驗證、接口權限的認證、以及對審計日誌的記錄處理,以及異常的跟蹤和傳遞,基本上應用服務層就是一個大內總管的角色,重要性不言而喻。

對於通過Winform方式展示界面,以Web API方式和後端的ABP的Web API服務進行數據交互,是我們之前已經完成的項目,項目界面如下所示。

主體框架界面採用的是基於菜單的動態生成,以及多文檔的界面布局,具有非常好的美觀性和易用性。

左側的功能樹列表和頂部的菜單模塊,可以根據角色擁有的權限進行動態構建,不同的角色具有不同的菜單功能點,如下是測試用戶登錄后具有的界面。

之前我們開發完成的Vue+Element的前端項目,默認已經具有登錄系統的功能,不過登錄是採用mock方式進行驗證並處理的,本篇隨筆介紹是基於實際的ABP項目進行用戶身份的登錄處理,這個也是開發其他接口展示數據的開始步驟,必須通過真實的用戶身份登錄後台,獲得對應的token令牌,才能進行下一步接口的開發工作。

例如對應登錄界面上,界面效果如下所示。

在用戶登錄界面中,我們處理用戶登錄邏輯代碼如下所示。

// 處理登錄事件 handleLogin() { this.$refs.loginForm.validate(valid => { if (valid) { this.loading = true this.$store .dispatch('user/login', this.loginForm) .then(() => { this.$router.push({ path: this.redirect || '/' }) this.loading = false }) .catch(() => { this.loading = false }) } else { console.log('error submit!!') return false } }) }

這裏主要就是調用Store模塊裏面的用戶Action處理操作。

例如對於用戶store模塊裏面的登錄Action函數如下所示。

const actions = { // user login login({ commit }, userInfo) { const { username, password } = userInfo return new Promise((resolve, reject) => { login({ username: username.trim(), password: password }).then(response => { const { result } = response // 獲取返回對象的 result var token = result.accessToken var userId = result.userId // 記錄令牌和用戶Id commit('SET_TOKEN', token) commit('SET_USERID', userId) // 存儲cookie setToken(token) setUserId(userId) resolve() }).catch(error => { reject(error) }) }) },

而其中 login({ username: username.trim(), password: password }) 操作,是通過API封裝處理的調用,使用前在Store模塊中先引入API模塊,如下所示。

import { login, logout, getInfo } from '@/api/user'

而其中 API模塊代碼如下所示。

export function login(data) { return request({ url: '/abp/TokenAuth/Authenticate', method: 'post', data: { UsernameOrEmailAddress: data.username, password: data.password } }) }

這裏我們用了一個/abp的前綴,用來給WebProxy的處理,實現地址的轉義,從而可以實現跨站的處理,讓前端調用外部地址就和調用本地地址一樣,無縫對接。

我們來看看vue.config.js裏面對於這個代理的轉義操作代碼。

而 http://localhost:21021/api 地址指向的項目,是我們本地使用ABP開發的一個後端Web API項目,我們可以通過地址 http://localhost:21021/swagger/index.html 進行接口的查看。

我們打開獲取授權令牌的Authenticate接口,查看它的接口定義內容

通過標註的1,2,我們可以看到這個接口的輸入參數和輸出JSON信息,從而為我們封裝Web API的調用提供很好的參考。

ABP框架統一返回的結果是result,這個result裏面才是返回對應的接口內容,如上面的輸出JSON信息裏面的定義。

所以在登陸返回結果后,我們要返回它的result對象,然後在進行數據的處理。

const { result } = response // 獲取返回對象的 result

然後通過result來訪問其他屬性即可。

var token = result.accessToken // 用戶令牌 var userId = result.userId // 用戶id

用戶登錄成功后,並獲取到對應的數據,我們就可以把必要的數據,如token和userid存儲在State和Cookie裏面了。

// 修改State對象,記錄令牌和用戶Id commit('SET_TOKEN', token) commit('SET_USERID', userId) // 存儲cookie setToken(token) setUserId(userId)

有了這些信息,我們就可以進一步獲取用戶的相關信息,如用戶名稱、介紹,包含角色列表和權限列表等內容了。

例如對應用戶信息獲取接口的ABP後端地址是 http://localhost:21021//api/services/app/User/Get

那麼我們前端就需要在API模塊裏面構建它的訪問地址(/abp/services/app/User/Get)和接口處理了。

export function getInfo(id) { return request({ url: '/abp/services/app/User/Get', method: 'get', params: { id } }) }

如上所示,在Store模塊里引入API模塊,如下所示。

import { login, logout, getInfo } from '@/api/user'

然後在Store模塊中封裝一個Action用來處理用戶信息的獲取的。

// 獲取用戶信息 getInfo({ commit, state }) { return new Promise((resolve, reject) => { getInfo(state.userid).then(response => { const { result } = response console.log(result) // 輸出測試 if (!result) { reject('Verification failed, please Login again.') } const { roles, roleNames, name, fullName } = result // 角色非空提醒處理 if (!roles || roles.length <= 0) { reject('getInfo: roles must be a non-null array!') } commit('SET_ROLES', { roles, roleNames }) commit('SET_NAME', name) // commit('SET_AVATAR', avatar) //可以動態設置頭像 commit('SET_INTRODUCTION', fullName) resolve(result) }).catch(error => { reject(error) }) }) },

Vue + Element前端項目的視圖、Store模塊、API模塊、Web API之間關係如下所示。

登錄后我們獲取用戶身份信息,在控制台中記錄返回對象信息,可以供參考,如下所示

有了token信息,我們就可以繼續其他接口的數據請求或者提交了,從而可以實現更多的管理功能了。

後續隨筆將基於ABP接口對接的基礎上進行更多界面功能的開發和整合。

列出一下前面幾篇隨筆的連接,供參考:

循序漸進VUE+Element 前端應用開發(1)— 開發環境的準備工作

循序漸進VUE+Element 前端應用開發(2)— Vuex中的API、Store和View的使用

循序漸進VUE+Element 前端應用開發(3)— 動態菜單和路由的關聯處理

循序漸進VUE+Element 前端應用開發(4)— 獲取後端數據及產品信息頁面的處理

循序漸進VUE+Element 前端應用開發(5)— 表格列表頁面的查詢,列表展示和字段轉義處理

循序漸進VUE+Element 前端應用開發(6)— 常規Element 界面組件的使用

循序漸進VUE+Element 前端應用開發(7)— 介紹一些常規的JS處理函數

循序漸進VUE+Element 前端應用開發(8)— 樹列表組件的使用

循序漸進VUE+Element 前端應用開發(9)— 界面語言國際化的處理

循序漸進VUE+Element 前端應用開發(11)— 圖標的維護和使用

本站聲明:網站內容來源於博客園,如有侵權,請聯繫我們,我們將及時處理

【其他文章推薦】

※帶您來了解什麼是 USB CONNECTOR ?

※自行創業缺乏曝光? 網頁設計幫您第一時間規劃公司的形象門面

※如何讓商品強力曝光呢? 網頁設計公司幫您建置最吸引人的網站,提高曝光率!

※綠能、環保無空污,成為電動車最新代名詞,目前市場使用率逐漸普及化

※廣告預算用在刀口上,台北網頁設計公司幫您達到更多曝光效益

※教你寫出一流的銷售文案?

※聚甘新

一.ConcurrentHashMap的模型圖

二.源碼分析-類定義

2.1 極簡ConcurrentHashMap定義

2.2 Segment內部類

2.3 HashEntry內部類

2.4 ConcurrentHashMap的重要常量

三.常用接口源碼分析

3.1 ConcurrentHashMap構造方法

3.2 map.put操作

3.3 創建新segment

3.4 segment.put操作

3.5 segment.rehash擴容

3.6 map.get操作

3.7 map.remove操作

3.8 map.size操作

原文地址:https://www.cnblogs.com/-beyond/p/13157083.html

之前看了Java8中的HashMap,然後想接着看Java8的ConcurrentHashMap,但是打開Java8的ConcurrentHashMap,瞬間就慫了,將近7k行代碼,而反觀一下Java7的Concurrent,也就在1500多行,那就先選擇少的看吧。畢竟Java7的ConcurrentHashMap更加簡單。下面所有的介紹都是針對Java7而言!!!!!

下面是ConcurrentHashMap的結構圖,ConcurrentHashMap有一個segments數組,每個segment中又有一個table數組,該數組的每個元素時HashEntry類型。

可以簡單的理解為ConcurrentHashMap是多個HashMap組成,每一個HashMap是一個segment,就如傳說中一樣,ConcurrentHashMap使用分段鎖的方式,這個“段”就是segment。

ConcurrentHashMap之所以能夠保證併發安全,是因為支持對不同segment的併發修改操作,比如兩個線程同時修改ConcurrentHashMap,一個線程修改第一個segment的數據,另一個線程修改第二個segment的數據,兩個線程可以併發修改,不會出現併發問題;但是多個線程同一個segment進行併發修改,則需要先獲取該segment的鎖后再修改,修改完后釋放鎖,然後其他要修改的線程再進行修改。

那麼,ConcurrentHashMap可以支持多少併發量呢?這個也就是問,ConcurrentHashMap最多能支持多少線程併發修改,其實也就是segment的數量,只要修改segment的這些線程不是修改同一個segment,那麼這些線程就可以并行執行,這也就是ConcurrentHashMap的併發量(segment的數量)。

注意,ConcurrentHashMap創建完成后,也就是segment的數量、併發級別已經確定,則segment的數量和併發級別都不能再改變了,即使發生擴容,也是segment中的table進行擴容,segment的數量保持不變。

下面是省略了大部分代碼的ConcurrentHashMap定義:

package java.util.concurrent;

import java.util.AbstractMap;

import java.util.concurrent.locks.ReentrantLock;

public class ConcurrentHashMap<K, V> extends AbstractMap<K, V> implements ConcurrentMap<K, V>, Serializable {

final Segment<K, V>[] segments;

/**

* segment分段的定義

*/

static final class Segment<K, V> extends ReentrantLock implements Serializable {

transient volatile HashEntry<K, V>[] table;

}

/**

* 存放的元素節點

*/

static final class HashEntry<K, V> {

}

}

ConcurrentHashMap內部有一個segments屬性,是Segment類型的數組,Segment類和HashMap很相似(Java7的HashMap),維持一個數組,每個數組是一個HashEntry,當發生hash衝突后,則使用拉鏈法(頭插法)來解決衝突。

而Segment數組的定義如下,省略了方法:

static final class Segment<K, V> extends ReentrantLock implements Serializable {

static final int MAX_SCAN_RETRIES = Runtime.getRuntime().availableProcessors() > 1 ? 64 : 1;

private static final long serialVersionUID = 2249069246763182397L;

// segment的負載因子(segments數組中的所有segment負載因子都相同)

final float loadFactor;

// segment中保存元素的數組

transient volatile HashEntry<K, V>[] table;

// 該segment中的元素個數

transient int count;

// modify count,該segment被修改的次數

transient int modCount;

// segment的擴容閾值

transient int threshold;

}

注意每個Segment都有負載因子、以及擴容閾值,但是後面可以看到,其實segments數組中的每一個segment,負載因子和擴容閾值都相同,因為創建的時候,都是使用0號segment的負載因子和擴容閾值。

Segment類中有一個table數組,table數組的每個元素都是HashEntry類型,和HashMap的Entry類似,源碼如下:(省略了方法)

/**

* map中每個元素的類型

*/

static final class HashEntry<K, V> {

final int hash;

final K key;

volatile V value;

volatile HashEntry<K, V> next;

}

ConcurrentHashMap中有很多常量,

// 默認初始容量 static final int DEFAULT_INITIAL_CAPACITY = 16; // 默認的負載因子 static final float DEFAULT_LOAD_FACTOR = 0.75f; // 默認的併發級別(同時支持多少線程併發修改) // 因為JDK7中ConcurrentHashMap中是用分段鎖實現併發,不同分段的數據可以進行併發操作,同一個段的數據不能同時修改 static final int DEFAULT_CONCURRENCY_LEVEL = 16; // 最大容量 static final int MAXIMUM_CAPACITY = 1 << 30; // 每一個分段的數組容量初始值 static final int MIN_SEGMENT_TABLE_CAPACITY = 2; // 最多能有多少個segment static final int MAX_SEGMENTS = 1 << 16; // slightly conservative // 嘗試對整個map進行操作(比如說統計map的元素數量),可能需要鎖定全部segment; // 這個常量表示鎖定所有segment前,嘗試的次數 static final int RETRIES_BEFORE_LOCK = 2;

ConcurrentHashMap有多個構造方法,但是內部其實都是調用同一個進行創建:

public ConcurrentHashMap() {

this(DEFAULT_INITIAL_CAPACITY, DEFAULT_LOAD_FACTOR, DEFAULT_CONCURRENCY_LEVEL);

}

public ConcurrentHashMap(int initialCapacity) {

this(initialCapacity, DEFAULT_LOAD_FACTOR, DEFAULT_CONCURRENCY_LEVEL);

}

public ConcurrentHashMap(int initialCapacity, float loadFactor) {

this(initialCapacity, loadFactor, DEFAULT_CONCURRENCY_LEVEL);

}

/**

* 統一調用的構造方法

*

* @param initialCapacity 初始容量

* @param loadFactor 負載因子

* @param concurrencyLevel 併發級別

*/

@SuppressWarnings("unchecked")

public ConcurrentHashMap(int initialCapacity, float loadFactor, int concurrencyLevel) {

// 校驗參數合法性

if (!(loadFactor > 0) || initialCapacity < 0 || concurrencyLevel <= 0) {

throw new IllegalArgumentException();

}

// 對併發級別進行調整,不允許超過segment的數量(超過segment其實是沒有意義的)

if (concurrencyLevel > MAX_SEGMENTS) {

concurrencyLevel = MAX_SEGMENTS;

}

// 根據concurrencyLevel確定sshift和ssize的值

int ssize = 1; // ssize是表示segment的數量,ssize是不小於concurrencyLevel的數,並且是2的n次方

int sshift = 0;// sshift是ssize轉換為2進制后的位數,比如ssize為16(1000),則sshift為4

while (ssize < concurrencyLevel) {

++sshift;

ssize <<= 1;

}

// 比如concurrencyLevel默認為16,走完循環,sshift為4,ssize為16

// 如果concurrentLevel為8,則sshift為3,ssize為8

// segment的shift偏移量

this.segmentShift = 32 - sshift;

// segment掩碼

this.segmentMask = ssize - 1;

// 對傳入的初始容量進行調整(不允許大於最大容量)

if (initialCapacity > MAXIMUM_CAPACITY) {

initialCapacity = MAXIMUM_CAPACITY;

}

// 假設傳入的容量為128,併發級別為16,則initialCapacity為128,ssize為16

int c = initialCapacity / ssize;

// c可以理解為根據傳入的初始容量,計算出每個segment中的數組容量

if (c * ssize < initialCapacity) {

++c;

}

// cap表示的是每個segment中的數組容量

int cap = MIN_SEGMENT_TABLE_CAPACITY;

// 如果默認的每個segment中的數組長度小於上面計算出來的每個segment的數組長度,則將容量翻倍

while (cap < c) {

cap <<= 1;

}

// 創建一個segment,作為segments數組的第一個segment

Segment<K, V> s0 = new Segment<K, V>(loadFactor, (int) (cap * loadFactor), new HashEntry[cap]);

// 創建segments數組

Segment<K, V>[] ss = (Segment<K, V>[]) new Segment[ssize];

// 將s0賦值給segments數組的第一個元素(偏移量為0)

UNSAFE.putOrderedObject(ss, SBASE, s0); // ordered write of segments[0]

// 複製segment數組

this.segments = ss;

}

/**

* 傳入map,將map中的元素加入到ConcurrentHashMap中

* 注意使用默認的負載因子(0.75)和默認的併發級別(16)

* 初始容量取map容量和默認容量的較大值

*/

public ConcurrentHashMap(Map<? extends K, ? extends V> m) {

this(Math.max((int) (m.size() / DEFAULT_LOAD_FACTOR) + 1, DEFAULT_INITIAL_CAPACITY),

DEFAULT_LOAD_FACTOR,

DEFAULT_CONCURRENCY_LEVEL);

putAll(m);

}

map.put,map就是指ConcurrentHashMap,其實就是確定HashEntry應該放入哪個segment中的哪個位置,所以可分為3步:

1.首先需要確定放入哪個segment;

2.確定segment后,再確定HashEntry應該放入segment的哪個位置;

3.進行覆蓋覆蓋或者插入。

/**

* put操作,注意key或者value為null時,會拋出NPE

*/

@SuppressWarnings("unchecked")

public V put(K key, V value) {

Segment<K, V> s;

if (value == null) {

throw new NullPointerException();

}

// 計算key的hash

int hash = hash(key);

// hash值右移shift位后 與 mask掩碼進行取與,確定數據應該放到哪個segments數組的哪一個segment中

int j = (hash >>> segmentShift) & segmentMask;

// 判斷計算出的segment數組位置上的segment是否為null,如果為null,則進行創建segment

if ((s = (Segment<K, V>) UNSAFE.getObject(segments, (j << SSHIFT) + SBASE)) == null) {

s = ensureSegment(j);

}

// 創建segment后,將數據put到segment中,調用的segment.put()

return s.put(key, hash, value, false);

}

上面put的時候,如果發現segment為null,則會進行調用ensureSegment進行創建segment,代碼如下:

/**

* 擴容(創建)segment

*

* @param k 需要擴容或者需要創建的segment位置

* @return 返回擴容后的segment

*/

@SuppressWarnings("unchecked")

private Segment<K, V> ensureSegment(int k) {

final Segment<K, V>[] ss = this.segments;

long u = (k << SSHIFT) + SBASE; // 傳入的index,對應的偏移量

Segment<K, V> seg;

// 判斷是否需要擴容或者創建segment,如果獲取到segment不為null,則返回segment

if ((seg = (Segment<K, V>) UNSAFE.getObjectVolatile(ss, u)) == null) {

Segment<K, V> proto = ss[0]; // “原型設計模式”,使用segments數組的0號位置segment

int cap = proto.table.length;// 0號segment的table長度

float lf = proto.loadFactor; // 0號segment的負載因子

int threshold = (int) (cap * lf); // 0號segment的擴容閾值

// 創建一個HashEntry的數組,數組容量和0號segment相同

HashEntry<K, V>[] tab = (HashEntry<K, V>[]) new HashEntry[cap];

// 再次檢測,指定的segment是不是為null,如果為null才進行下一步操作

if ((seg = (Segment<K, V>) UNSAFE.getObjectVolatile(ss, u)) == null) { // recheck

// 創建segment

Segment<K, V> s = new Segment<K, V>(lf, threshold, tab);

// 使用CAS將新創建的segment填入指定的位置

while ((seg = (Segment<K, V>) UNSAFE.getObjectVolatile(ss, u)) == null) {

if (UNSAFE.compareAndSwapObject(ss, u, null, seg = s)) {

break;

}

}

}

}

// 返回新增的segment

return seg;

}

上面需要注意的是:

1.創建segment中的table數組時,是使用0號segment的table屬性(長度、負載因子、閾值);

2.創建segment前會進行再check,check發現segment的確為null時,再進行創建segment;

3.利用CAS來將創建的segment填入segments數組中;

當確定HashEntry應該放到哪個segment后,就開始調用segment的put方法,如下:

/**

* 在確定應該存放到那個segment后,就segment.put()將k-v存入segment中

*

* @param key put的key

* @param hash hash(key)的值

* @param value put的value

* @param onlyIfAbsent true:key對應的Entry不進行覆蓋,false:key對應的entry存在與否,都進行put覆蓋

* @return

*/

final V put(K key, int hash, V value, boolean onlyIfAbsent) {

// 先獲取鎖(ReentrantLock,內部使用非公平鎖)

HashEntry<K, V> node = tryLock() ? null : scanAndLockForPut(key, hash, value);

V oldValue;

try {

HashEntry<K, V>[] tab = table;

// 根據hash值計算出在segment的table中的位置

int index = (tab.length - 1) & hash;

// 定位到segment的table的index位置(第一個節點)

HashEntry<K, V> first = entryAt(tab, index);

// 從第一個節點開始遍歷

for (HashEntry<K, V> e = first; ; ) {

// 節點不為空,則判斷是否key是否相同(相同HashEntry)

if (e != null) {

K k;

// 比較是否key是否相等(判斷put的key是否已經存在)

if ((k = e.key) == key || (e.hash == hash && key.equals(k))) {

// 如果key已經存在,則進行覆蓋,如果onlyIsAbsent為false(不關心key對應的Entry是否存在)

oldValue = e.value;

if (!onlyIfAbsent) {

// 覆蓋舊值,修改計數加1

e.value = value;

++modCount;

}

break;

}

e = e.next;

} else {

// 頭插法,將put的k-v創建新HashEntry,放到first的前面

if (node != null) {

node.setNext(first);

} else {

node = new HashEntry<K, V>(hash, key, value, first);

}

// segment中table元素數量加1

int c = count + 1;

// 加1后的size大於擴容閾值,且數組的長度小於最大容量,則進行rehash

if (c > threshold && tab.length < MAXIMUM_CAPACITY) {

// 擴容,並進行rehash

rehash(node);

} else {

// 將節點放入數組中的指定位置

setEntryAt(tab, index, node);

}

// 修改次數加一,修改segment的table元素個數

++modCount;

count = c;

// 舊值為null

oldValue = null;

break;

}

}

} finally {

// 釋放鎖

unlock();

}

return oldValue;

}

梳理一下,大致在做下面幾件事:

1.先獲取鎖(ReetrantLock,內部使用非公平鎖NonFairSync);

2.獲取到鎖后根據hash計算出在table的位置;

3.遍歷table的HashEntry的鏈表,如果有相同key的,則進行覆蓋,如果沒有,在進行頭插法;

4.插入鏈表后,確定是否需要擴容,需要則執行rehash;

5.修改計數(count、modCount),並且釋放鎖。

segment擴容時,會將該segment的容量擴容為之前的2倍,並且將各位置的鏈表節點元素進行rehash。

/**

* 將segment的table容量擴容一倍(newCap=oldCap*2),注意只會擴容該node所在的segment

*

* @param node segment[i]->鏈表的頭結點

*/

@SuppressWarnings("unchecked")

private void rehash(HashEntry<K, V> node) {

HashEntry<K, V>[] oldTable = table;

int oldCapacity = oldTable.length;

// 新容量為舊容量的2倍

int newCapacity = oldCapacity << 1;

// 設置新的擴容閾值

threshold = (int) (newCapacity * loadFactor);

// 申請新數組,數組長度為新容量值

HashEntry<K, V>[] newTable = (HashEntry<K, V>[]) new HashEntry[newCapacity];

// 循環遍歷segment的數組(舊數組)

int sizeMask = newCapacity - 1; // 新的掩碼

for (int i = 0; i < oldCapacity; i++) {

// 獲取第i個位置的HashEntry節點,如果該節點為null,則該位置為空,不作處理

HashEntry<K, V> e = oldTable[i];

if (e != null) {

HashEntry<K, V> next = e.next;

// 計算新位置

int idx = e.hash & sizeMask;

// next為null,表示該位置只有一個節點,直接將節點複製到新位置

if (next == null) { // Single node on list

newTable[idx] = e;

} else { // Reuse consecutive sequence at same slot

HashEntry<K, V> lastRun = e;

int lastIdx = idx;

for (HashEntry<K, V> last = next; last != null; last = last.next) {

int k = last.hash & sizeMask;

if (k != lastIdx) {

lastIdx = k;

lastRun = last;

}

}

newTable[lastIdx] = lastRun;

// 從頭結點開始,開始將節點拷貝到新數組中

for (HashEntry<K, V> p = e; p != lastRun; p = p.next) {

V v = p.value;

int h = p.hash;

int k = h & sizeMask;

HashEntry<K, V> n = newTable[k];

newTable[k] = new HashEntry<K, V>(h, p.key, v, n);

}

}

}

}

// 將頭結點添加到segment的table中

int nodeIndex = node.hash & sizeMask; // add the new node

node.setNext(newTable[nodeIndex]);

newTable[nodeIndex] = node;

table = newTable;

}

為啥擴容的時候沒有加鎖呀?

其實已經加鎖了,只不過不是在rehash中加鎖!!!因為rehash是在map.put中調用,put的時候已經加鎖了,所以rehash中不用加鎖。

get操作,先定位到segment,然後定位到segment的具體位置,進行獲取

/**

* 從ConcurrentHashMap中獲取key對應的value,不需要加鎖

*/

public V get(Object key) {

Segment<K, V> s;

HashEntry<K, V>[] tab;

// 計算key的hash

int h = hash(key);

// 計算key處於哪一個segment中(index)

long u = (((h >>> segmentShift) & segmentMask) << SSHIFT) + SBASE;

// 獲取數組中該位置的segment,如果該segment的table不為空,那麼就繼續在segment中查找,否則返回null,因為未找到

if ((s = (Segment<K, V>) UNSAFE.getObjectVolatile(segments, u)) != null && (tab = s.table) != null) {

// tab指向segment的table數組,通過hash計算定位到table數組的位置(然後開始遍歷鏈表)

HashEntry<K, V> e;

for (e = (HashEntry<K, V>) UNSAFE.getObjectVolatile(tab, ((long) (((tab.length - 1) & h)) << TSHIFT) + TBASE);

e != null; e = e.next) {

K k;

// 判斷key和hash是否匹配,匹配則證明找到要查找的數據,將數據返回

if ((k = e.key) == key || (e.hash == h && key.equals(k)))

return e.value;

}

}

return null;

}

刪除節點,和get的流程差不多,先定位到segment,然後確定segment的哪個位置(哪條鏈表),遍歷鏈表,找到後進行刪除。

/**

* 刪除map中key對應的元素

*/

public V remove(Object key) {

// 計算key的hash

int hash = hash(key);

// 根據hash確定segment

Segment<K, V> s = segmentForHash(hash);

// 調用segment.remove進行刪除

return s == null ? null : s.remove(key, hash, null);

}

/**

* 刪除segment中key對應的hashEntry

* 如果傳入的value不為空,則會在value匹配的時候進行刪除,否則不操作

*/

final V segmeng.remove(Object key, int hash, Object value) {

// 獲取鎖失敗,則不斷自旋嘗試獲取鎖

if (!tryLock()) {

scanAndLock(key, hash);

}

V oldValue = null;

try {

HashEntry<K, V>[] tab = table;

// 定位到segment中table的哪個位置

int index = (tab.length - 1) & hash;

HashEntry<K, V> e = entryAt(tab, index);

HashEntry<K, V> pred = null;

// 遍歷鏈表

while (e != null) {

K k;

HashEntry<K, V> next = e.next;

// 如果key和hash都匹配

if ((k = e.key) == key || (e.hash == hash && key.equals(k))) {

V v = e.value;

// 如果沒有傳入value,則直接刪除該節點

// 如果傳入了value,比如調用的map.remove(key,value),則要value匹配才會刪除,否則不操作

if (value == null || value == v || value.equals(v)) {

if (pred == null) { // 頭結點就是要找刪除的元素,next為null,則將null賦值數組的該位置

setEntryAt(tab, index, next);

} else { //

pred.setNext(next);

}

// 修改次數加一,map數量減一

++modCount;

--count;

oldValue = v;

}

break;

}

// 不匹配時,pred保存當前一次檢測的節點,e指向下一個節點

pred = e;

e = next;

}

} finally {

unlock();// 釋放鎖

}

return oldValue;

}

ConcurrentHashMap的size(),需要統計每一個segment中的元素數量(也就是count值),因為不同的segment允許併發修改,統計過程中可能會出現修改操作,導致統計不準確,所以要想準確統計整個map的元素數量,可以這樣做:通過加鎖的方式來解決(將所有的segment都加鎖),這樣就能保證元素不會變化了,這是我們的想法。

而ConcurrentHashMap是這樣解決的,先嘗試不加鎖進行統計兩次,這兩次統計,不止會統計每個segment的元素數量,還會統計每個segment的modCount(修改次數),進行匯總;如果兩次統計的modCount總量相同,也就說明兩次統計期間沒有修改操作,證明統計的元素總量正確;如果兩次modCount總量不相同,表示有修改操作,則進行重試,如果重試后,發現還是不準確(modCount不匹配),那麼就嘗試為所有的segment加鎖,再進行統計。

源碼如下:

/**

* 獲取ConcurrentHashMap中的元素個數,如果元素個數超過Integer.MAX_VALUE,則返回Integer.MAX_VALUE

*/

public int size() {

final Segment<K, V>[] segments = this.segments;

int size; // 返回元素數量(統計結果->元素的總量)

boolean overflow; // 標誌是否溢出(是否超過Integer.MAX_VALUE)

long sum; // 所有segment的modCount總量次數(整個map的修改次數)

long last = 0L; // previous sum,上一輪統計的modCount總量

int retries = -1; // 記錄重試的次數

try {

// 此處for循環主要用於控制重試

for (; ; ) {

// 重試的次數如果達到RETRIES_BEFORE_LOCK,則強制獲取所有segment的鎖

if (retries++ == RETRIES_BEFORE_LOCK) {

for (int j = 0; j < segments.length; ++j) {

ensureSegment(j).lock();

// 強制獲取segment的table第i個位置,並加鎖

}

}

sum = 0L;

size = 0;

overflow = false;

// 開始對segments中的每一個segment中進行統計

for (int j = 0; j < segments.length; ++j) {

// 獲取第j個segment

Segment<K, V> seg = segmentAt(segments, j);

// 如果segment不為空,則進行統計

if (seg != null) {

sum += seg.modCount;

int c = seg.count;

// size累加

if (c < 0 || (size += c) < 0)

overflow = true;

}

}

// 如果本次統計的modCount總量和上次一樣,則表示在這兩次統計之間沒有進行過修改,則不再重試

if (sum == last) {

break;

}

// 記錄本次統計的modCount總量

last = sum;

}

} finally {

// 判斷是否加了鎖(如果retries大於RETRIES_BEFORE_LOCK),則證明加了鎖,於是進行釋放鎖

if (retries > RETRIES_BEFORE_LOCK) {

for (int j = 0; j < segments.length; ++j)

segmentAt(segments, j).unlock();

}

}

return overflow ? Integer.MAX_VALUE : size;

}

本站聲明:網站內容來源於博客園,如有侵權,請聯繫我們,我們將及時處理

【其他文章推薦】

※為什麼 USB CONNECTOR 是電子產業重要的元件?

※網頁設計一頭霧水該從何著手呢? 台北網頁設計公司幫您輕鬆架站!

※台北網頁設計公司全省服務真心推薦

※想知道最厲害的網頁設計公司“嚨底家”!

※推薦評價好的iphone維修中心

※聚甘新